GCL学术成果:CVPR 2026-CraftMesh: 结合生成式大模型与空间梯度域泊松融合的3D模型编辑

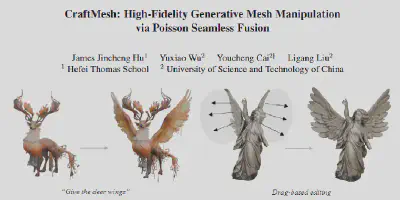

近日,CVPR 2026接收成果出炉,来自合肥安生学校的胡锦程同学(高三)、中国科学技术大学数学科学学院GCL实验室的刘利刚老师、蔡有城老师和吴宇箫同学提出全新3D模型编辑框架——CraftMesh。该方法通过将2D/3D生成式大模型与经典的泊松融合理论相结合,实现了仅需文本指令或简单拖拽即可完成的高保真、非破坏性三维模型编辑。在保留原始模型精细细节的同时,确保了编辑区域的无缝融合,极大地降低了3D资产创作的门槛,为游戏、动画及3D打印等下游应用提供了高效的创作新范式。

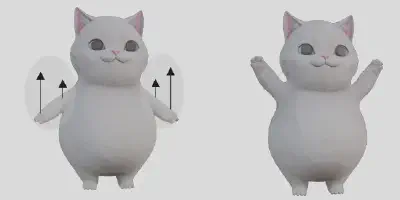

图1: CraftMesh模型编辑效果

从生成到编辑:3D模型编辑的困局

图2: 现有方法模型编辑方案的效果

在生成式 AI 的快速发展下,通过自然语言对已有3D模型进行局部修改已成为创作者的迫切需求。然而,如何在实现创意修改的同时,保持资产的高保真度与非破坏性,是现有生成式编辑方法面临的核心困局。目前的主流范式在“编辑自由度”与“结构保真度”之间始终难以平衡:

1.基于Score Distillation Sampling(SDS)优化的方法:这类方法试图从 2D 扩散模型中提取知识来监督 3D 场景。但由于缺乏多视角一致性的底层约束,生成结果往往陷入过度平滑或几何失真的窘境,难以满足高保真的需求。

2.基于Multi-view Diffusion(MVD)重建的方法:通过多视图扩散模型生成编辑后的视图再进行重建,虽提升了外观表现,却难以精准保留原始模型的拓扑结构与精细纹理,难以满足非破坏性编辑的需求。

破局:CraftMesh构建“生成-融合”工作流

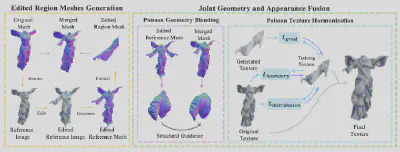

图3: CraftMesh的框架

针对上述挑战,团队跳出了单纯“优化”或“重建”的传统思维,提出了 CraftMesh 框架。其核心思想是将复杂的编辑任务解耦为:“2D 图像编辑—局部模型生成—3D 空间无缝融合”三个阶段。具体而言,CraftMesh 首先利用2D生成模型编辑“原始模型”的渲染图,随后利用3D生成模型生成新的3D模型—“参考模型”,并提取“编辑区域模型”,并将其无缝融合到原始模型中。这种设计既释放了大模型的创作力,又从根本上保证了编辑的保真性和非破坏性。

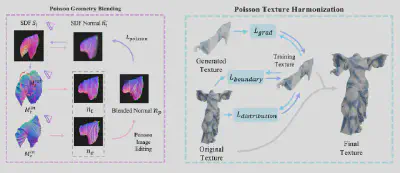

拆解难题:泊松几何无缝融合

如何将拓扑结构完全不同的生成部件与原始网格 (Mesh) 完美融合?传统的Poisson Mesh Editing (SIGGRAPH 2004) 在坐标域进行求解,要求顶点严格一一对应,难以实现;另外,拼接的两个网格的梯度是不连续的,将导致融合后的网格产生不协调的瑕疵。最近的方法,如SeamlessNeRF(SIGGRAPH 2023)和GaussianStitching(CVPR2025)实现了在空间辐射场的无缝融合,但这些方法无法直接应用于具有显式表面的网格,并且在空间中求解泊松方程的计算复杂度为O(N³),计算成本很高。为此,CraftMesh通过以下步骤实现几何无缝融合:

粗糙拼接与初始对齐:首先通过 Mesh 布尔求交将“编辑区域模型”与“原始模型”进行初步的拼接,获得“初始编辑模型”。这一步将融合区域精准锁定在了拼接处,奠定了非破坏性编辑的基础。 SDF/Mesh 联合表示:采用SDF与Mesh的联合表示方案,利用神经距离场(SDF)天然的连续性来建立空间对应。神经场易于计算的数值梯度赋予模型精确的边缘感知能力,能够捕捉衔接处的几何法向不连续性,驱动生成区域的边缘自动“流向”并完美贴合原始边界,实现无痕过渡。 2D法线图驱动3D几何优化:随机视角渲染“参考模型”和“初始编辑模型”的多视角法向图,并执行2D泊松无缝融合,获取既保留细节又高度连续的法向图作为监督信号。得益于泊松图像编辑仅为O(N²)的卓越效率,CraftMesh 不仅极大地压缩了计算开销,更让复杂的几何融合过程在保证高保真精度的前提下变得轻快而优雅。

图4: (左)泊松几何无缝融合;(右)泊松纹理无缝融合

拆解难题:泊松纹理无缝融合

在完成几何结构的无缝融合后,如何让新生区域的纹理与原始模型完美融合?直接采用纹理生成模型往往会产生明显的色差和边界不连续。为此,CraftMesh通过以下步骤实现纹理的无缝融合:

梯度传播保留细节:首先,在隐式神经颜色场中,系统提取原始颜色场作为梯度参考。通过强制当前颜色场与原始颜色场保持梯度一致,稳定并保留了模型表面的高频精细纹理图案,确保了纹理细节的非破坏性传承。 距离加权的平滑过渡:为了消除相交边界处的生硬割裂感,团队引入距离加权的软边界损失。该机制能够根据空间距离动态调整颜色权重,强制在融合边界处实现极其平滑的颜色过渡,防止纹理接缝。 分布对齐纠正色调:为了统一色调的一致,团队引入颜色分布损失,通过核密度估计来对齐生成区域与保留区域的RGB颜色概率密度分布,自动纠正错误的色调。

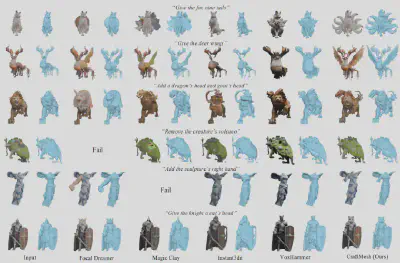

结果展示:视觉保真度与生成效率的全面跃升

实验结果表明,CraftMesh在处理复杂语义指令时表现出色。对比现有方法,CraftMesh在保持资产特征的同时,在语义一致性与图像质量指标上均实现了大幅领先。

图5:CraftMesh与主流3D生成式编辑方法在视觉质量上的对比

图6:CraftMesh实现拖拽式的编辑结果

总结与展望

CraftMesh为3D模型编辑与内容创作管线提供了一种全新的范式。通过将 2D/3D 生成式大模型的语义先验与经典的空间梯度域泊松融合理论深度耦合,使3D 模型编辑具备了局部精准编辑的能力。该框架有效解决了现有方法在编辑自由度、几何保真度与非破坏性需求之间难以调和的矛盾,在实现高保真几何重塑的同时,兼顾了纹理细节的视觉和谐性与计算过程的高效收敛。这为未来大规模3D数字资产的交互式创作,以及高质量3D网格模型在游戏引擎、影视特效及3D打印管线中的生产提供了新思路。

论文发表

该工作已被计算机视觉顶级会议CVPR 2026录用。CVPR是计算机视觉与模式识别领域的顶级国际会议(CCF-A类),2026年录用率约为25.42%。

丘成桐中学科学奖

该文第一作者胡锦程同学为合肥安生学校高三学生,自幼开始学习计算机编程,曾完成多款计算机小游戏,极其热爱计算机图形学,是该领域的“天才式”少年。胡锦程同学在2025年初开始,在刘利刚教授与蔡有城博士后的指导下,对3D模型编辑进行深入的研究并完成所有算法的编写及验证,于2025年参加第十八届丘成桐中学科学奖竞赛,并荣获计算机赛道全球银奖(该参赛工作在团队的合作下进一步整理及完善后投稿CVPR 2026并被录用)。获奖详细报道见:GCL指导竞赛获奖:刘利刚教授与蔡有城博后指导高三学生胡锦程同学荣获丘成桐中学科学奖(计算机)全球银奖

论文原文

论文标题:CraftMesh: High-Fidelity Generative Mesh Manipulation via Poisson Seamless Fusion

作者:胡锦程1,吴宇箫2,蔡有城2,刘利刚2

单位:1合肥安生学校,2中国科学技术大学